Ce texte se base énormément sur le thread twitter de Ben Tappin.

Mais d’où vient cette propension de croire en des choses fausses, parfois même absurde ? Quels sont les moteurs de l’extrémisme, du complotisme et des fake news ? La capacité cognitive permet-elle un meilleur discernement ou alors permet-elle au contraire de justifier encore plus fortement nos croyances politiquement motivées ?

Ce sont des questions sur lesquelles on trouve de nombreuses études, surtout issues des recherches en psychologie. Autant le dire tout de suite : il n’y a pas de consensus actuellement sur le sujet, et encore beaucoup d’inconnus.

Néanmoins, on sait certaines choses, ou plutôt -soyons épistémiquement raisonnables- on pense savoir certaines choses.

Une hypothèse bien établie…

Ainsi, de nombreuses recherches ont établis qu’une forte capacité de raisonnement n’empêche pas l’adhésion à des idées fausses, et il semblerait même que cette capacité cognitive aurait plutôt tendance à renforcer cette adhésion lorsque ces idées épousent l’orientation politique/idéologique à laquelle on adhère. Aussi, contrairement à ce qu’on pourrait croire, une bonne culture scientifique n’aiderait en rien (sauf si celle-ci est soutenue par une curiosité naturelle)…

Celà peut paraître contre-intuitif, car on pense généralement qu’une plus grande « intelligence » est le meilleur moyen de lutter contre des croyances infondées. Mais il y aurait un revers de la médaille à cette « grande capacité cognitive »: un raisonnement politiquement motivé va utiliser les facultés intellectuelles en présence pour justifier sa propre vision et trouver les arguments les plus solides possibles 1)« Solides », ne voulant pas forcément dire « vrais », dans ce cas, mais plutôt dans le sens de « complexe », ou en langage courant « plus difficile à démonter ».

C’est notamment ce qu’explique Gérald Bronner dans La démocratie des crédules : les personnes soutenant des idées infondées sont bien souvent des personnes avec un niveau d’éducation un peu supérieur à la moyenne.

Ceci tendrait à expliquer pourquoi nous avons une forte tendance au biais de confirmation lorsqu’il s’agit de sujets teintés politiquement, et pourquoi nous avons tendance à moins vérifier et en même temps à plus facilement partager ce qui va dans notre sens, même si c’est faux.

… Mais remise en question

Cette hypothèse, soutenue par des résultats solides, à récemment été questionnée par plusieurs études menées par Gordon Pennycook et David Rand, dont une méta-analyse actuellement en prépublication.

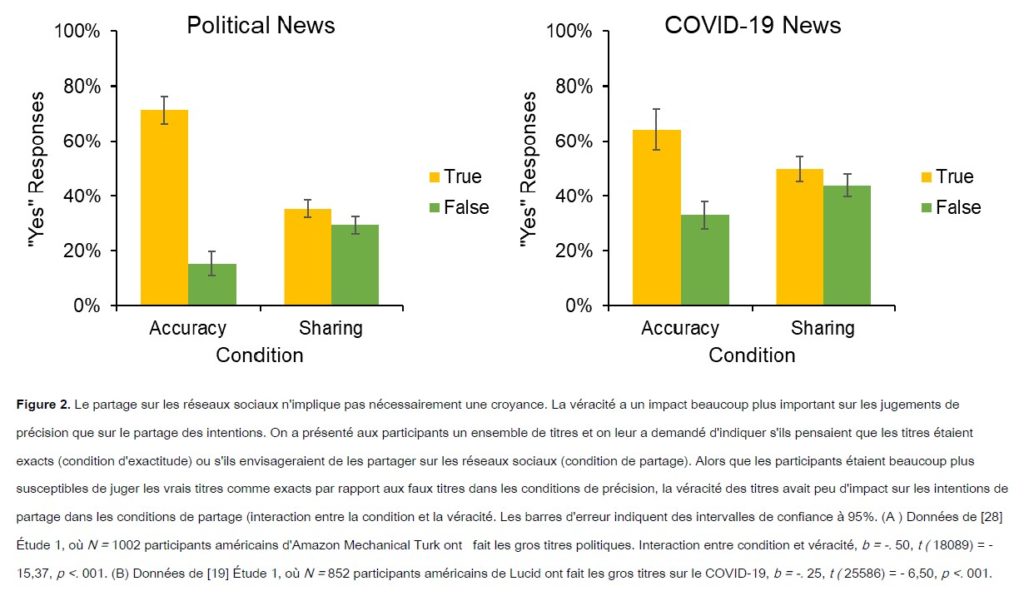

Au regard de l’ensemble de la littérature sur ce thème, les auteurs ont ainsi constaté que lorsqu’on demandait d’évaluer la véracité d’une information, les gens parvenait très souvent à discriminer le vrai du faux. En revanche, lorsqu’on leur demandait à la place s’ils partageraient ces mêmes informations sur les réseaux sociaux, la véracité n’avait guère d’importance.

Pour expliquer cela, il ont formulé plusieurs hypothèses, qu’ils ont soumis aux données de la littérature scientifique.

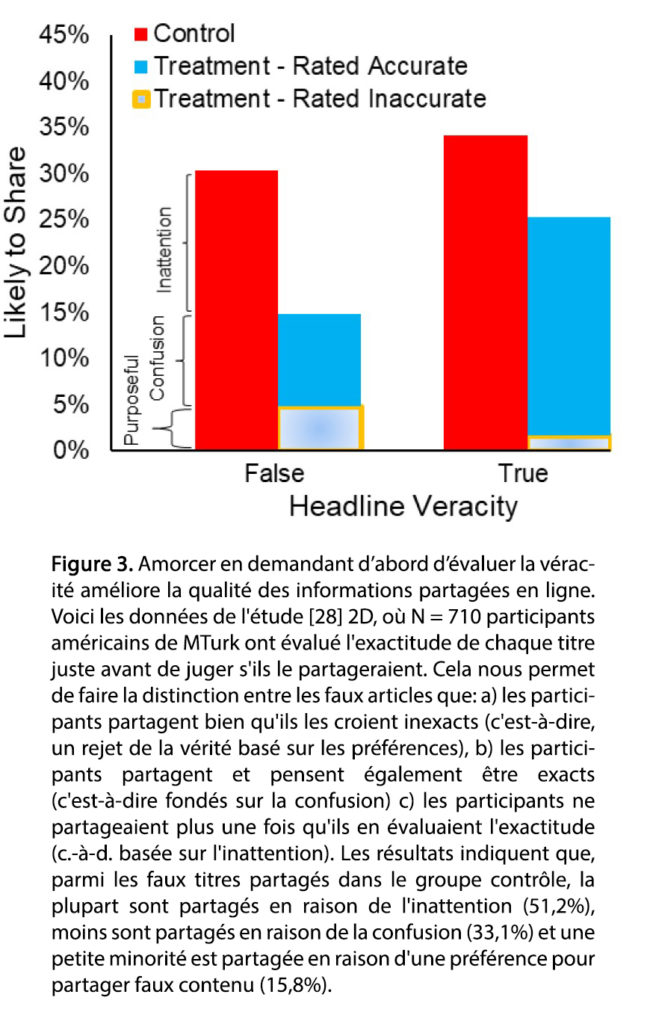

Hypothèse 1 : La confusion

La première explication qu’ils ont envisagé était fondée sur l’idée de la confusion, idée selon laquelle les gens croiraient sincèrement (mais à tort) que les faux articles qu’ils partagent seraient probablement vrais. Sur cette question, les auteurs ont constaté que par rapport au groupe contrôle (auquel on ne demandait pas d’évaluer la véracité, en rouge sur la fig.3), seulement 33% des faux titres partagés étaient à la fois crus et partagés par les participants interrogés sur l’exactitude (en bleu). Ainsi, la prévalence du partage fondé sur la confusion était étonnamment faible.

Hypothèse 2 : Le raisonnement politiquement motivé

La deuxième explication qu’ils ont envisagée est le récit basé sur l’idéologie politique. Pour faire simple, cette idée, souvent soutenue comme prédominante, estime que les gens placent leurs préférences politiques au-dessus de la vérité. En découle la fameuse idée que nous vivrions une ère dites de « post-vérité ». Selon cette hypothèse, nous pouvons déduire que les gens partagent du faux contenu (et, en particulier, du contenu politiquement cohérent), tout en reconnaissant que ce n’est probablement pas vrai. La militance, faire passer ses idées, passe devant l’honnêteté. Cependant, les auteurs ont constaté que, parmi les fausses nouvelles partagées par les participants, seulement 16% étaient partagées même si elles étaient identifiées comme étant inexactes.

Hypothèse 3 : l’inattention

Enfin : le manque de réflexion est une source d’erreurs de jugement. L’idée est que les gens auraient une forte préférence pour partager du contenu exact, mais que le contexte des médias sociaux les détourne de cette préférence. Et en effet, les auteurs ont constaté que la plupart des participants classaient explicitement l’exactitude comme l’un des principaux facteurs de motivation. Plus important encore, demander aux participants d’évaluer l’exactitude de chaque titre avant de décider de le partager a réduit le partage de faux titres de 51% par rapport à la condition de base. Ainsi, il semble que le contexte des médias sociaux empêche les gens de prendre le temps de considérer l’exactitude.

Conformément à ce point de vue, les travaux sur le comportement des médias sociaux soulignent souvent l’importance de «l’économie de l’attention» où les facteurs liés à «l’engagement» (likes, partages, commentaires, clics, etc.) sont utilisés dans les environnements de ces médias. Pour cette raison, il n’est peut-être pas surprenant que le partage de contenus d’information de mauvaise qualité sur Facebook soit associé à une extrémité idéologique et que la concordance idéologique soit un prédicteur beaucoup plus fort du partage que de la croyance. Les médias sociaux permettent également aux personnes qui se sentent socialement et politiquement marginalisées de partager des rumeurs politiques hostiles.

Une possibilité émergeante est que le contexte des médias sociaux lui-même détourne les gens de la priorité à la vérité lorsqu’ils décident de ce qu’ils doivent partager – et, dans certains cas, peut activement promouvoir un comportement antisocial et entraver l’exercice de la pensée analytique et critique. Les médias sociaux peuvent être à la fois une cause et une conséquence d’un engagement politique accru, à la fois bon et mauvais.

Celà ne veut pas dire que le raisonnement politiquement motivé n’a pas d’influence, mais que son importance est moindre que ce que l’on pensait et que d’autres facteurs (comme l’inattention et le manque de réflexion) ont un impact plus remarquable encore. Ainsi, selon eux « la paresse (intellectuelle) » est le facteur principal de l’adhésion à de nouvelles idées (vraies ou fausses) et cette paresse serait un effet issu de l’écosystème des réseaux sociaux.

Une sorte de Démocratie des feignasses, en quelque sorte, pour reformuler l’expression de Gérald Bronner.

Démocratie des feignasses : comment repenser le raisonnement politiquement motivé ?

Dans une étude publiée en 2018 dans la revue Cognition, soit 2 ans avant leur méta-analyse, Pennycook et Rand concluaient déjà:

« la pensée analytique est utilisée pour évaluer la plausibilité des titres [de journaux, vrais ou faux, NdT], indépendamment du fait que les histoires soient cohérentes ou incompatibles avec l’idéologie politique de chacun. Nos résultats suggèrent donc que la vulnérabilité aux fausses nouvelles est davantage motivée par une pensée paresseuse que par un parti pris partisan ».

C’est alors, qu’il se sont questionné sur le bien fondé de cette idée reçue selon laquelle l’idéologie politique orienterait fortement l’adhésion à de fausses nouvelles.

Plus récemment, en septembre 2020, Pennycook soumet une méta-étude (une étude contenant plusieurs études rassemblées) réalisée avec Rand et Ben Tappin, qui sera publiée en octobre dans le Journal of experimental Psychology: General. Cette étude aura un intitulé explicite : « Repenser le lien entre la sophistication cognitive et le raisonnement politiquement motivé. »

Une autre vision

Rappelons que l’idée communément admise en psychologie sur la question est que la sophistication cognitive amplifie le raisonnement politiquement motivé (qui par extension génère les données véhiculées par l’opinion publique).

D’abord, il faut savoir que les croyances antérieures des gens sur ce qu’ils pensent « vrai » influencent également leur raisonnement sur les nouvelles informations.

Ensuite, les motivations concernant les groupes politiques des gens et celles concernant leurs croyances antérieures politiquement pertinentes sont souvent corrélées. Cela pourrait survenir parce que les motivations provoquent des croyances, si par exemple les gens recherchent de préférence des informations en accord avec leur propre orientation politique.

Cependant, les motivations et les croyances peuvent également être corrélées car elles partagent des causes communes. Par exemple, parler avec un ami militant peut à la fois encourager à rejoindre son idéologie politique (–> motivation) et permet également d’acquérir des informations et des arguments à priori pertinents (–> croyances).

Le problème, c’est que pour déterminer si la sophistication cognitive amplifie l’effet total du raisonnement motivé (motivation du groupe politique + croyances antérieures), il faut maintenant ajuster U. Mais U est très difficile à mesurer. Il est plus facile de déterminer si la sophistication amplifie l’effet direct, en s’ajustant aux croyances antérieures pertinentes (prior beliefs).

Ainsi, dans leur étude « Rethinking the link between cognitive sophistication and politically motivated reasoning« , Pennycook et ses collaborateurs ont adopté cette approche dans 3 études se penchant sur l’opinion concernant le changement climatique et celle concernant le contrôle des armes à feu. Ils n’ont observé aucune preuve suggérant que la sophistication cognitive amplifiait un effet direct de la motivation des groupes politiques sur le raisonnement.

Comme le montre la figure suivante, en l’absence d’ajustement pour les croyances antérieures pertinentes, la sophistication cognitive a systématiquement amplifié le coefficient sur l’identité du groupe politique (rangées du haut) – reproduisant les travaux antérieurs. Mais l’ajustement des croyances antérieures pertinentes a atténué cette association de manière fiable (rangées du bas).

En d’autres termes : En oubliant de prendre en compte les croyances fondamentales (« antérieures et pertinentes« ), l’influence de celles-ci était confondue avec la motivation du groupe politique dans les études précédentes.

Ainsi, leur étude a trouvé des preuves que la sophistication amplifiait un effet direct des croyances antérieures sur le raisonnement : les croyances antérieures servent ainsi d’intermédiaire à la motivation (à gauche) et / ou les deux sont simplement confondues par U (à droite). Mais les expériences ne permettent pas de distinguer les deux hypothèses !

Sur cette base, les auteurs estiment que la preuve expérimentale que la sophistication cognitive amplifie le raisonnement politiquement motivé est moins évidente qu’on ne le suppose souvent.

L’effet de la sophistication cognitive

Revenons à la méta-analyse.

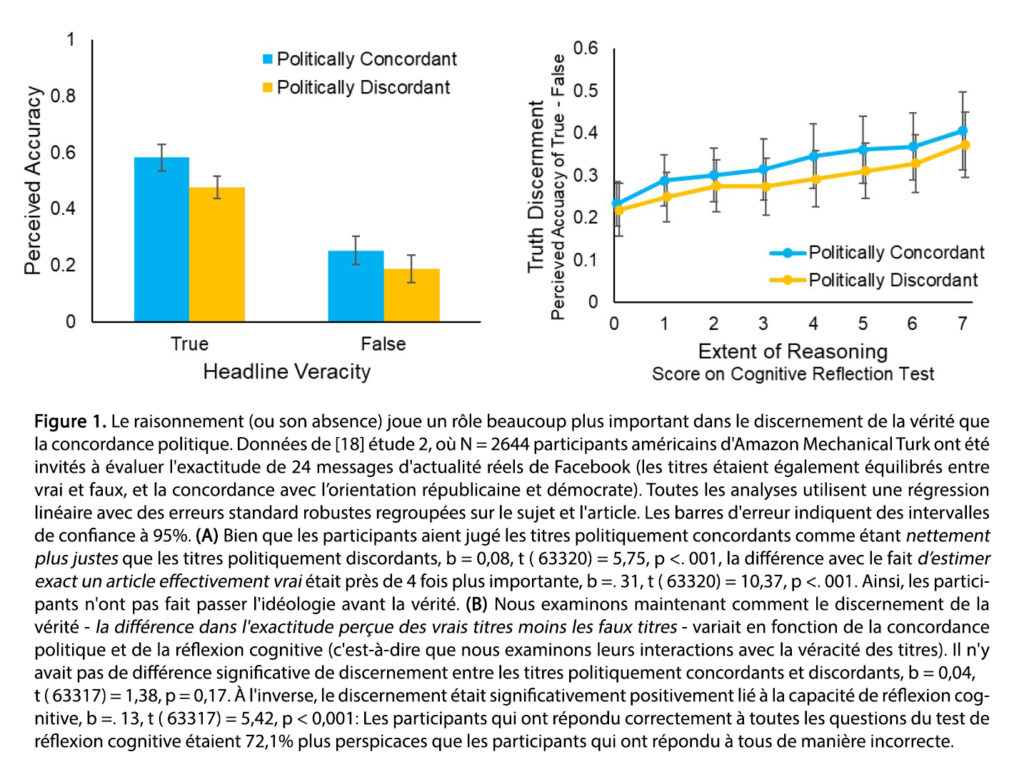

Comme nous l’avons vu, les auteurs ont donc estimé que lorsque l’orientation politique d’une information était concordante avec l’opinion politique, celà ne jouaient pas un rôle majeur dans la capacité à évaluer la véracité d’une information. Celà a été confirmé lorsqu’ils ont comparé les effets nets sur la question.

En effet, sur la Figure 1, il y a une légère tendance à considérer comme plus souvent vraies des informations politiquement concordantes, qu’elles soient vraies ou qu’elles soient fausse (le bleu est systématiquement plus haut que le jaune), mais la capacité à ne pas se tromper dans l’évaluation de la véracité d’une information est nettement plus importante, quelle que soit l’orientation politique (les deux barres de « True » sont nettement au dessus de celles de « False »).

Enfin, à droite de cette figure 1, nous avons une courbe définissant la capacité à discerner la vérité, en fonction des capacités cognitives. Et c’est une autre surprise de cette étude : si une haute capacité semble mieux permettre de discerner le vrai du faux (les courbes sont plus élevées à droite qu’à gauche, et cette évolution est constante), la concordance politique avec les opinions des sujets n’a pas permis d’augmenter ou de diminuer significativement cette capacité à discriminer (l’écartement entre les courbes est relativement constant et ne dépasse jamais les intervalles de confiance -les fines barres noires-).

Ainsi, cette meta-analyse permet d’interroger deux idées reçues sur la question, que d’autres études avaient pourtant nettement appuyé. D’autres recherches permettront probablement de valider ou non ces hypothèses, mais l’intérêt des travaux de Pennycook et ses collègues sur la question réside dans la prise en compte de variables qui étaient (selon eux) confondues avec la variable « orientation politique ». Leur méta-analyse permet ainsi d’analyser les données disponibles, tout en essayant de prendre en compte ces variables confondantes et d’ainsi d’affiner les limites et la portée de nos connaissances…

COMPLÉMENT:

Une autre étude revient sur l’hypothèse de Pennycook et ses collègues, concernant l’asymétrie des partages (les gens partagent moins de Fake News que ce qui était attendu). Sacha Altay, Anne-Sophie Hacquin et Hugo Mercier ont interprété ces résultats différemment et ont réalisé une étude pour vérifier leur hypothèse. Ils ont ainsi confirmé que si les gens partagent finalement assez peu de Fake news, c’est essentiellement parce que rendre public une adhésion à ces idées altèrerait leur réputation auprès de leurs « amis » et followers. Ces idées étant « socialement inacceptables », ce serait mal vu. Ainsi les personnes qui en partage régulièrement sont des personnes qui ont déjà construit ou intégré un réseaux déjà tolérant aux fake news (les réseaux complotistes, notamment).

L’article est ici : https://www.researchgate.net/publication/346311907_Why_do_so_Few_People_Share_Fake_News_It_Hurts_Their_Reputation

Notes

| ↑1 | « Solides », ne voulant pas forcément dire « vrais », dans ce cas, mais plutôt dans le sens de « complexe », ou en langage courant « plus difficile à démonter » |

|---|